ディープラーニングを活用して高精度、省コスト、省スペースな距離測定を実現

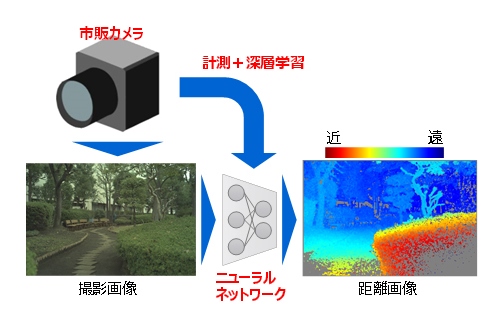

株式会社東芝は、レンズによって生じる画像のぼけをディープラーニングで解析することで、市販のカメラで撮影した1枚の画像からステレオカメラ(注1)並みに高精度な距離計測を実現する立体認識AIを開発した。ステレオカメラを必要としないため、コストとスペースの削減が可能とななる。

ロボットピッキング、無人配送車の自律移動、ドローン遠隔操作によるインフラ点検などに活用

近年、ロボットによる物品のピックアップや工場内の無人搬送車の自律移動、ドローンの遠隔操作によるインフラ点検など、さまざまな分野で画像センシングの重要性が増している。

これらの用途では、被写体の画像を撮影するだけでなく、小型装置での、形状や距離情報などの3次元情報の把握が求められている。

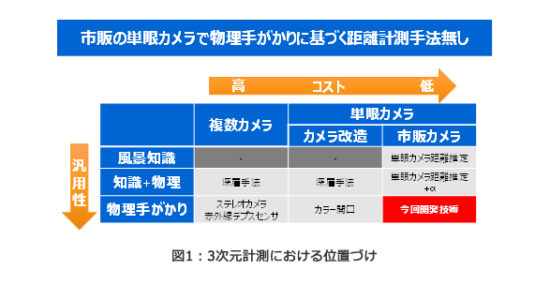

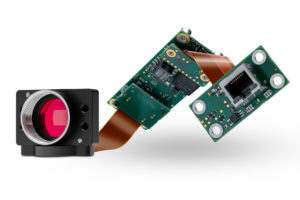

このようなニーズに対して、小型化に適した単眼カメラを使用した計測技術の開発に注目が集まっており、ディープラーニングによって被写体の形状や背景などの風景情報を学習し、距離を推定する単眼カメラ距離推定技術の研究が活発化している。

しかし、単眼カメラによる距離推定技術の精度は学習した風景情報に依存するため、学習した風景情報と異なる背景で撮影すると精度が著しく低下する欠点がある。

同社は2色のカラーフィルタをレンズに挿し、被写体までの距離に応じて生じる画像ぼけの色と大きさを分析することで、風景情報に依存せずに距離を推定するカラー開口撮影技術を開発(注2、3、4)したが、既存レンズの改造に伴うコストと手間が課題となっていた(図1)。

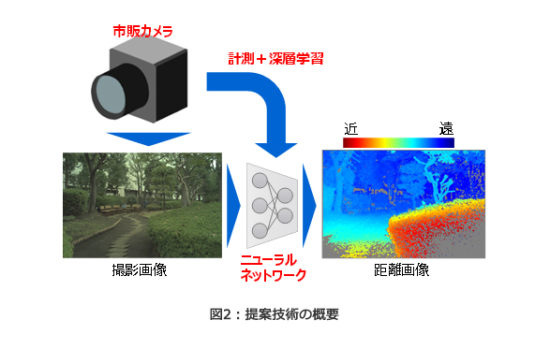

そこで同社は、ディープラーニングを活用してレンズ上の位置によって画像がどのようにぼけているか(ぼけの形状)を解析することで、通常の単眼カメラのみで、風景情報にも依存せずステレオカメラ並みの高精度な距離計測を実現する立体認識AIを開発した(図2)。

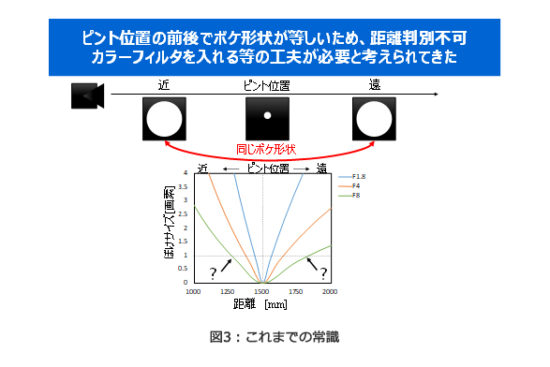

これまでは、理論的にはピント位置から等距離であれば遠近どちらのポイントでもぼけの形状が等しくなるため、ぼけの形状から距離を計測することは難しいと考えられてきた(図3)。

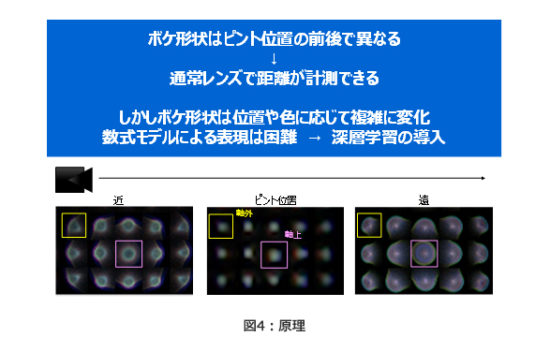

ところが、実際にぼけの形状を分析してみると、ピント位置から等距離であっても遠近それぞれのポイントでぼけの形状に大きな違いがあることが分かった(図4)。

そこで、深層ニューラルネットワークモデルを学習するディープラーニングによって、撮影した画像からぼけの情報を解析することに成功した。

ぼけの形状は、光が通ったレンズ内の位置と光の波長によって変化することが分かっている。

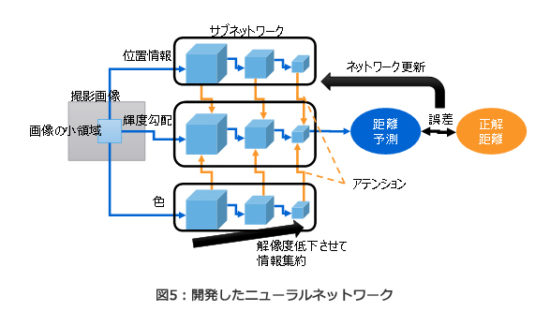

開発したネットワークは、ぼけの形状の変化を適切に捉えられるように位置と色情報を個別に処理し、アテンションと呼ばれる重み付け機構を経て、輝度勾配のどの部分に重点を置けば正しく距離が計測できるのかを制御するために活用される(図5)。

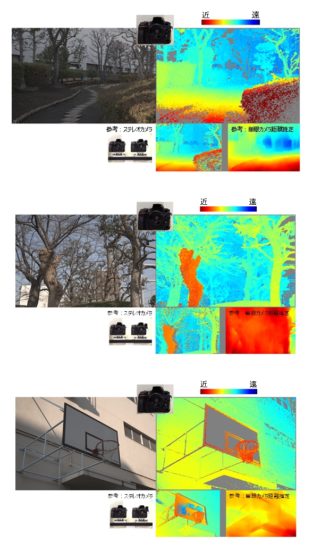

学習の過程で、予測した距離と実際の距離の誤差を小さくするようにネットワークを更新。同社は本AIを活用した結果、市販カメラの一枚の撮影画像からステレオカメラに匹敵する高精度な距離計測を実現できることを確認した(図6)。

図6:距離画像の例

今後、市販されているカメラとレンズで汎用性の確認と画像処理の高速化を進め、2020年度を目指して社会実装を進めていくとしている。

■問い合わせ

株式会社東芝

https://www.toshiba.co.jp/

コメントを残す