NECソリューションイノベータでは、車載用のFPGA-ARM SoCで動作する画像認識ソフトウェアを開発した。また、今後求められる技術として、3D LiDARとカメラのセンサフュージョンと、Deep Learningの車載マイコンへの適用について取り組みを進めており、あわせて本稿にて紹介する。

開発の経緯

NECグループでは、1970年代より、指紋認証、手書き文字認識に代表される画像認識技術の研究開発を行っており、警察や郵便関連で現在でも使用されている。

これら技術をベースに、2000年代初頭より、車載での画像認識ソフトウェアの受託開発を行い、多くの車両メーカ、サプライヤに対応してきた 一方、市場では、乗用車への先進運転支援システム(ADAS:Advanced Driver Assistance Systems)や自動運転の実用化とともに、これら技術の重機や農機など自動車以外の分野への適用が進むなど、市場範囲が広がっている。

このため、当社では、従来の受託開発のみならず、画像認識ソフトウェアをIP化するとともに、FPGA(Field-Programmable Gate Array)をベースとした車載マイコンへの実装を行うことで、多様な要求に対応可能である。

また、本分野では認識性能や認識機能のさらなる向上が求められており、センサフュージョンとDeep Learningといった最新技術への取り組みを進めている。本稿では、当社の画像認識ソフトウェアを紹介するとともに、最新技術の取組みについて説明する。

特徴

当社のソフトウェアは、自動車への適用を前提としていることから、低消費電力の車載マイコンで動作可能であることを特徴としている。特に、ハイビジョンクラスの解像度の複数カメラ入力に対して、複数の認識処理を1つの車載マイコンにて実行可能である。

これを実現するため、当社ではFPGA-ARMのSoC(System On Chip)を使用し、処理内容に応じた負荷分散を行っている。 具体的には、画像認識で負荷の高い処理や並列性が高い処理をFPGA上に配置することで、負荷分散を行い、処理時間の高速化を実現している。

FPGA上に配置した処理は、画像の特徴量を抽出する際に行うフィルタ処理、特徴点の時系列の移動を抽出するオプティカルフロー、指定した画像領域を走査するラスタスキャン処理、直線や円などの形状を抽出するハフ変換といった画像認識の基本処理である。

画像認識を目的とした車載マイコンは数多くあり、当社もGPU(Graphics Processing Unit)に代表されるSIMD(Single Instruction/Multiple Date)型プロセッサや、画像認識に特化した ASSP(Application Specific Standard Product)などの車載マイコンへの実装を経験している。

これらから、車載マイコンの選定は一長一短であり、製品コンセプト、求めるシステムアーキテクチャなどにより変化する。その中で当社は、FPGAをリファレンスとして画像認識ソフトウェアのラインアップを整えた。

これは、FPGAが車載で問題となる発熱に対して優位であることに加え、プログラマブルなことから、認識アルゴリズムの更新や入れ替え等、実装の自由度が高いことがあげられる。

製品の概要

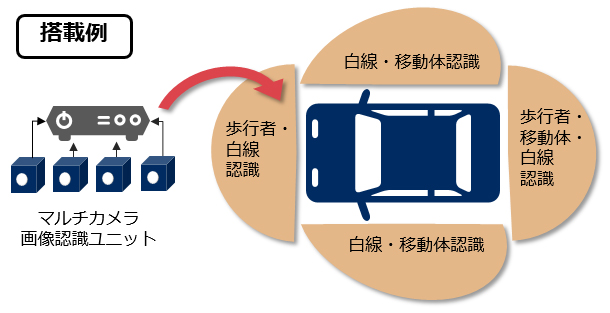

本製品では、サラウンドビューなどのカメラを複数接続したコントロールユニットに対して、画像認識ソフトウェアを搭載することを想定している(図1)。

図1 認識機能付きサラウンドビューのイメージ図

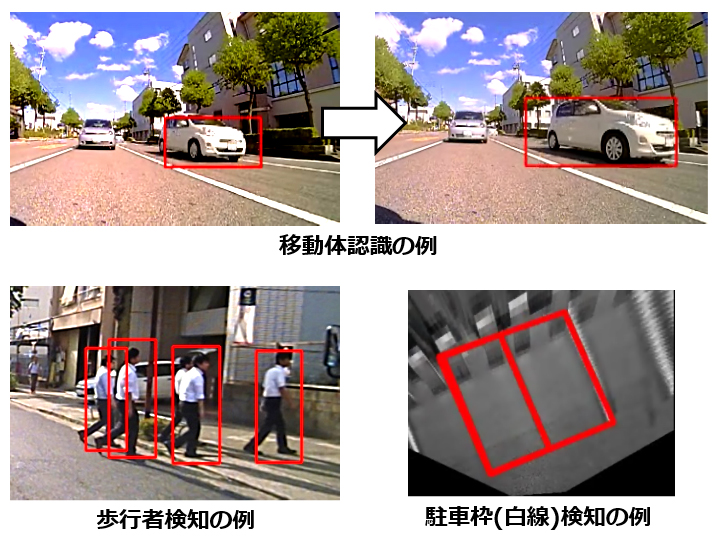

現在、画像認識ソフトウェアは、制限速度や止まれ等の道路標識認識、車両周囲の歩行者認識、走行レーンや駐車枠などの白線認識、時系列で移動する物体を抽出する移動体認識、の4種類を用意している(図2、3)。

システム構成として、これら4種類の認識ソフトウェアから、画像入出力、描画、FPGAとCPUとの処理I/Fなどの共通部分をレイヤとして設けることで、冗長性を排除するとともに、認識ソフトウェア間の同期や調停の役割も担っている(図2)。

.jpg)

図2 マルチカメラ画像認識ソフトウェア構成図

図3 マルチカメラ画像認識ソフトウェ認識例

また、OSはマルチコアとマルチタスクの対応が必要であることから、本製品では組込Linuxを採用している(図2)。なお、本製品では、画像認識の部分に特化しており、画像圧縮などのエンコード・デコード、歪補正や鳥瞰変換などの幾何補正については、ユーザのシステム構成に依存することが多いことから、個別での対応としている。

各認識ソフトウェアは、ユーザの要求仕様が様々であることから、最低限必要となる基本要素に実装を留めている。但し、システム化において最も課題となるHWリソースの可用性を高めるため、FPGA回路規模、メモリ帯域、CPU処理負荷については使用量が最小となるよう対策を施している。

認識性能においては、使用するカメラへの依存度が高いことから、学習のサンプル数や、パラメータチューニングは必要最低限としている。OSについては、将来、リアルタイムOSへの適用を想定して、OS依存は最低限となるようにしている。

このように、各認識ソフトウェアを、各要求仕様に対応するため、当社では、要求仕様策定をはじめ、アーキテクチャ設計、機能設計、実装、評価などのソフトウェア開発と、機械学習の辞書構築、認識パラメータチューニング等の認識部分の対応などのサービスを提供している。

本製品の搭載例を、図4に示す。ここでは、4chのカメラ入力に対して、移動体認識を3カメラ分、白線検知を1カメラ分、同時に動作可能としている。この時、処理時間は100ms以下であり、ADASで重要となるリアルタイム性を実現している。

.jpg)

図4 マルチカメラ画像認識ソフトウェア実装例

機能・性能向上に向けて

1)センサフュージョン

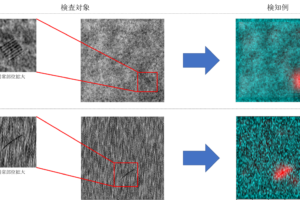

当社ではこれまでの市場ニーズから、画像では認識が困難なシチュエーションへの対応を進めている。

具体的には、カメラで不得意な奥行情報(距離情報)が必要な道路の段差や工事現場など不整地での路面状況、形状変化が大きい物体の認識などに対して、正確な距離と分解能を保有している3D LiDAR(Light Detection and Ranging)とカメラ画像を組み合わせたセンサフュージョンの技術開発に取り組んでいる。

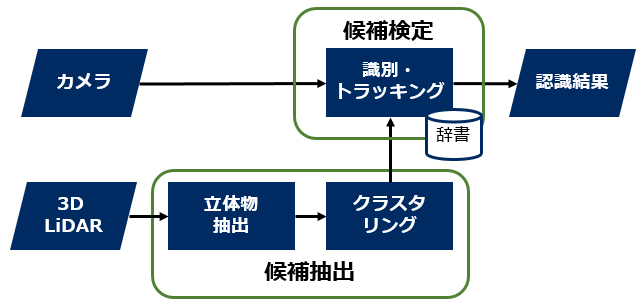

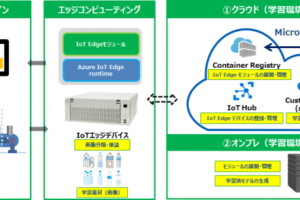

3D LiDARとカメラのセンサフュージョンでは、大まかな空間把握を行う候補抽出と、物体の識別を行う候補検定の2つの処理で構成されている(図5)。候補抽出では、3D LiDARのデータから路面推定を行い、それに基づいて立体物の抽出を行う。

図5 センサフュージョン処理構成

抽出した立体物に対してクラスタリングを行い、認識対象の形状に合わせて各クラスタの抽出を行う。たとえば、歩行者を抽出する場合は、歩行者の物理的な幅や高さから、車両、街路樹、建物と分離を行う(図6)。

-1.jpg)

図6 3D LiDARによる候補抽出

候補検定の部分では、あらかじめ3D LiDARとカメラ間で実施されたキャリブレーションに基づき、クラスタリングされた部分を画像上にマッピングを行い、マッピングされた画像の部分に対して機械学習にて対象物か否かの識別を行う(図7)。

.jpg)

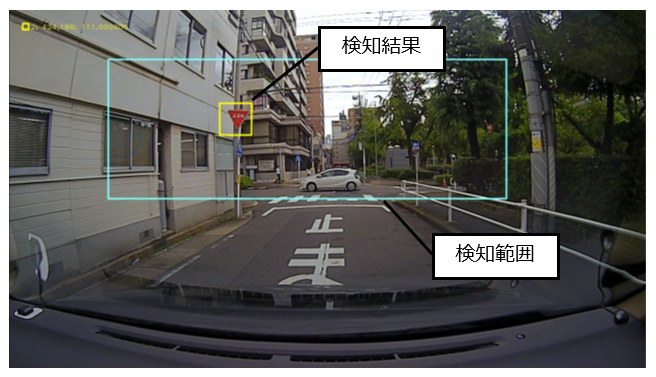

図7 検知結果(枠)

当社では、認識対象は歩行者とし、機械学習はAdaBoostとして、ARM 上にて実装を行った(Cortex-A53 クアッドコア 1.5GHz)。この時、認識率は、画像のみで認識した際と比較し、35%の検知性能向上を確認することができた(当社比)。誤検知については、4分の1に軽減することができた(当社比)。また、処理時間は、100ms以下である。

2)組込Deep Learning

近年、車載画像認識は、多様な認識への対応が求められている。これまで車載画像認識では、処理の軽量さと、学習のしやすさから、SVM(Support Vector Machine)に代表とされる統計的機械学習が主流であったが、多様な認識に対応するためには特徴量が不足していた。

このため、近年、認識性能の飛躍的な向上を実現しているDeep Learningを本分野に適用する技術開発に取りに組んでいる。ただし、Deep Learningは、認識性能向上とともに、演算量が非常に増加しており、車載マイコンに搭載できないリスクがあった。

これに対応するため、認識性能を低減させず、演算量を軽減可能な二値化CNN(Convolutional Neural Network)を適用することにした。なお、二値化CNNでは、演算ビット数の冗長性を軽減することで演算量軽減を実現する手法である。

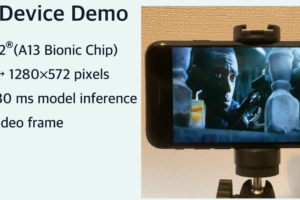

実装例として、道路標識認識をFPGA(Xilinx Zynq UltraScale+ MPSoC ZCU102 Evaluation Kit)上に実装し、約34msの処理時間を実現することができた。なお、実装したFPGAは車載用ではないが、車載用のFPGAに回路規模が収まるよう実装を行った。

具体的には車載グレード品であるXilinx Zynq Ultra Scale XAZU5EVの回路規模に搭載可能とすることを目標とした。また、標識が画像中に映る画像上部の720×280の領域を検知範囲とした(図8)。

図8 組込Deep Learningによる認識例

今後に向けて

これまで、画像では認識困難なシチュエーションへの対応のためにセンサフュージョンと、多様な認識への対応のために組込Deep Learningを進めてきた。

当社では、これを発展・具体化させるため、大きな形状変化を伴う人物のしゃがみ等への対応を行うことを予定している。これは、市場ニーズとして、駐車中の自動車の周辺にいる人や、商用車の周辺で運搬等の作業をしている人の認識が必要であることが理由である。

また、センサフュージョンでは、3D LiDARを使用した、自己位置推定や高精度立体地図を実現す る SLAM(Simultaneous Localization and Mapping)技術への拡張を予定している。

これは一般道での自動運転の実現のみならず、工事現場や作業場など、建物や構造物が日々変化する環境下での自動運転に必要とされる技術である。 最後に、これら自動運転に必要となるさまざまな画像認識技術のさらなる開発を推し進め、市場に幅広く適用されることを目指していく。

■問い合わせ

NECソリューションイノベータ株式会社

TEL: 03-5534-2626(東日本窓口)/

06-6945-3824(西日本窓口)

E-mail:info_esl@nes.jp.nec.com

http://www.nec-solutioninnovators.co.jp/sl/emb/development/multicamera.html

コメントを残す